Denne bloggposten er skrevet i samarbeid med HR-ekspertene hos Töölön Vire.

|

Oppsummering

|

Kunstig intelligens (vi kaller det AI) har blitt en stor del av de aller fleste folk med en digital hverdag, og det har veldig mange fordeler. Det har også noen farer, og det har EU fått med seg. Derfor har de siden starten av 2025 gradvis innført en lov rundt teknologien som har tatt verden med storm. Hovedregelen trer i kraft 2. August, og innen den ting er det noen ting du må ha kontroll over det.

Å forberede seg på compliance er ikke bare en juridisk øvelse. Det er også et strategisk lederansvar. I mange organisasjoner spiller HR en sentral rolle i å sikre at bruken av AI i rekruttering, prestasjonsledelse og behandling av medarbeiderdata er både i tråd med regelverket og etisk forsvarlig.

Hvem gjelder dette?

-

De som bor/jobber i et EU- eller EØS-land.

-

De som bruker AI som kategoriseres som høyrisiko.

-

De som bruker dette til rekruttering, kritisk infrastruktur (bank og forsikring) og utdanning.

-

Utviklerne av AI-ene og distributørene av disse.

Hva er den nye hovedregelen?

Selv om hovedregelen ikke trer i kraft før 2. august er det viktig å være i gang med dette allerede nå.

Den nye regelen handler i hovedsak om AI-systemer med høy risiko. I praksis betyr det:

-

Risikostyring: Sette opp systemer for risikostyring.

-

Datakvalitet: Om dere bruker data til å trene AI, må dere sikre at det er høy datakvalitet.

-

Dokumentasjon: Bedriften deres må ha teknisk dokumentasjon på at dere følger loven.

-

Transparens: Brukere skal informeres om hvordan systemet fungerer.

-

Menneskelig tilsyn: AI-systemene skal overvåkes av mennesker.

I praksis krever reell menneskelig kontroll mer enn et navn på et dokument. Organisasjoner trenger tydelige styringsmodeller, klart definert ansvar og opplærte ledere som forstår både teknologien og risikoen den innebærer. Det er her strukturert kompetansebygging innen AI blir avgjørende.

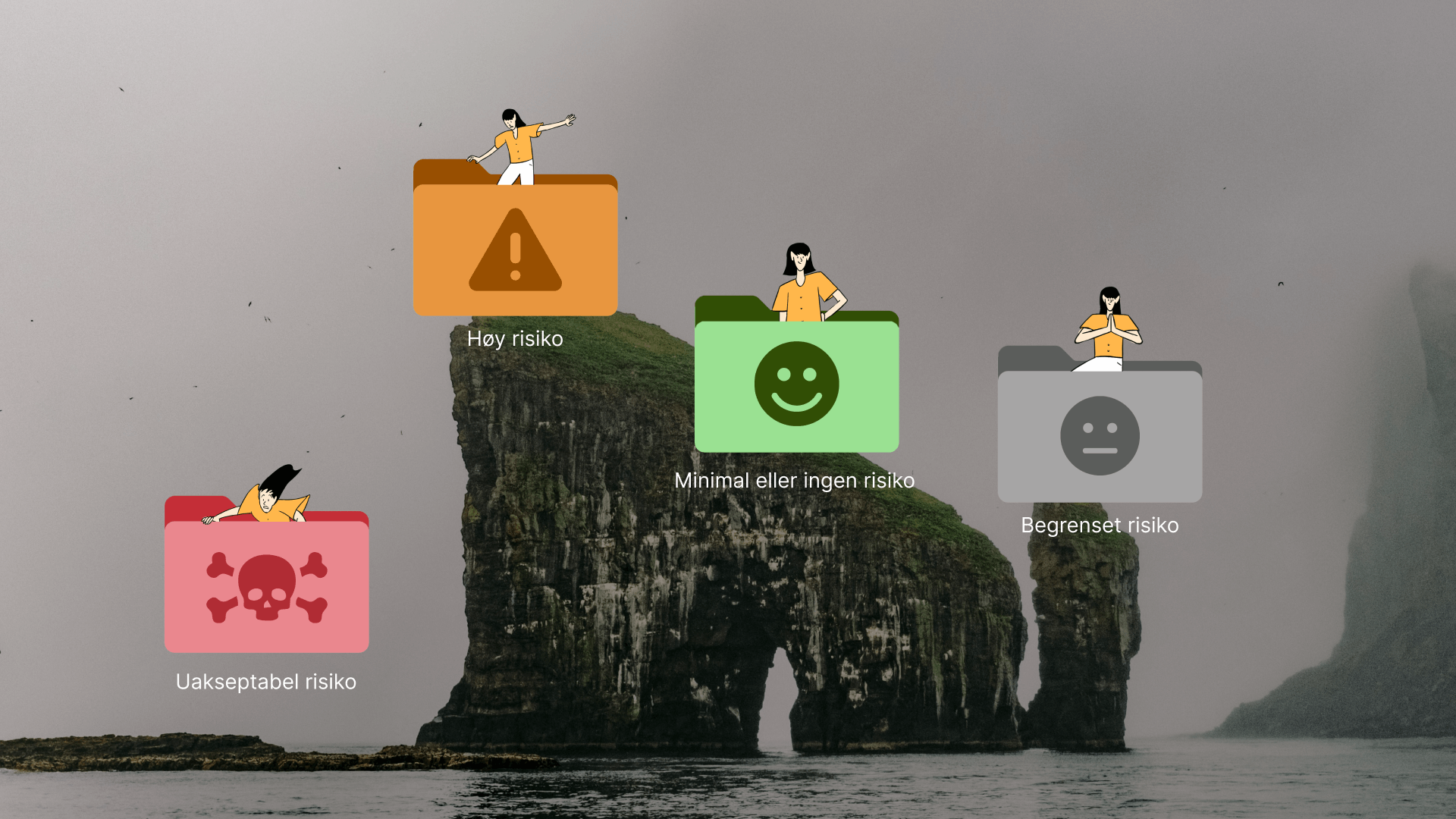

AUs AI Act sine fire nivåer av risiko

AI Act opererer med fire nivåer av risiko. Allmenne AI-modeller som ChatGPT og Copilot er også truffet av loven. Det stilles forskjellige krav til hver av risikonivåene:

-

Uakseptabel risiko: Totalt forbud mot AI-modeller som utgjør uakseptabel risiko.

-

Høy risiko: AI Act stiller strenge krav til systemer med høy risiko, blant annet at man må påse at systemet ikke diskriminerer.

-

Begrenset risiko: Om systemet utgjør begrenset risiko må du informere om det det.

-

Minimal eller ingen risiko: Systemer uten eller med minimal risiko er i utgangspunktet ikke regulert av AI Act, men det er fortsatt anbefalt å sette opp etiske retningslinjer til bruk av dette.

Jobb med et HR-system som kjenner til risikonivåene.

Kjapt oppsummert

Vi sa det i starten av dette blogginnlegget, men vi sier det igjen: AI er kjempebra til mye, men man må være oppmerksom på risikoene ved det, for dem er det mange av. Om du jobber basert på de fire risikonivåene og gjør evalueringer av systemene du bruker, så vil du være på trygg grunn. Og husk, det menneskelige vil fortsatt være viktig og verdifullt!

Organisasjoner som behandler AI Act som en ren compliance-sjekkliste, risikerer å gå glipp av den større muligheten. De som integrerer AI-styring i HR- og lederstrategien sin, kan samtidig styrke tillit, åpenhet og langsiktig konkurransekraft.

Ofte stilte spørsmål

- Gjelder AI Act for oss hvis vi bare bruker ChatGPT internt?

-

Ja, men kravene varierer. Bruker dere AI til rekruttering eller prestasjonsvurdering, gjelder de strengere kravene. Bruker dere det til referater og rapporter, er kravene langt lavere. Gjør en rask gjennomgang av hva dere faktisk bruker AI til, så vet dere hvor dere står.

- Hva skjer om vi ikke er i samsvar med loven innen 2. august 2026?

-

Tilsyn og sanksjoner vil variere noe fra land til land, men å vente og se er en risiko de fleste ikke ønsker å ta. Start med å kartlegge hvilke AI-systemer dere bruker og kategoriser dem etter risikonivå. Det er et overkommelig sted å begynne.

- Hvem i organisasjonen bør eie arbeidet med AI Act-compliance?

-

Det er et tverrfaglig ansvar mellom HR, IT og ledelse. Men siden rekruttering, medarbeiderdata og prestasjonsledelse er i kjernen av det direktivet regulerer, bør HR sitte ved bordet når bedriften kartlegger AI-bruk og setter opp styringsmodeller.

Om Töölön VireHos Töölön Vire bygger de HR-tjenester for små og mellomstore bedrifter – slik bedriftene faktisk ønsker. Ofte på en måte de nesten ikke har turt å tro var mulig.

|

.png?width=604&height=318&name=Siljes%20Corner_%20mega%20nav%20promo2%20(1).png)